Когда перед вами стоит задача попасть в топ Яндекса, Google и прочих поисковых систем, и вы хотите на это как-то повлиять, то здесь важно понимать, что ваш сайт будет оцениваться поисковыми машинами на основе сложных алгоритмов, которые, кстати, сами далеко не совершенны и постоянно развиваются. Разработчики поисковых систем вовсе не скрывают что их алгоритмы не совершенны, более того, чтобы показать насколько все сложно, они для примера говорят, что если им показать какой-то сайт, то они не смогли бы сами ответить с ходу на каком месте он будет в выдаче и через какое время, если сейчас произвести с этим сайтом какие-то модификации. Современные поисковые алгоритмы — это самообучающиеся программы, некая потуга на искусственный интеллект. У таких алгоритмов хватает своих недостатков, например "переобученность" и т. п. Поэтому, например, у компании Яндекс есть в штате сотрудники "Асессоры", задача которых вручную оценивать сайты. Результаты работы асессоров являются ориентиром для самообучающейся программы, в общем, если кому еще интересно это, можете почитать http://company.yandex.ru/technologies/l ... /index.xml

Существуют базовые принципы, по которым поисковые системы оценивают сайты, которые в большей части и определяют насколько хорошо будет ранжироваться сайт. Собственно, основной способ достичь хороших позиций в поисковой выдаче — это постараться сделать так чтобы ваш сайт максимально удовлетворял этим критериям:

- На сайте должна быть уникальная (не скопированная у других) информация: тексты, картинки, таблицы, списки, информация должна быть удобно структуирована.

Но нельзя злоупотреблять (спамить) и писать, как говорит руководитель отдела веб-поиска компании Яндекс Александр Садовский "Портянки" текста с целью имитации полезной информации. Если спамить, то вместо повышения позиций, вы получите наоборот пессимизацию. Я сам не раз видел такие ресурсы, люди заказывали написание дорогих текстов в больших количествах, а результатом был бан сайта поисковыми системами.

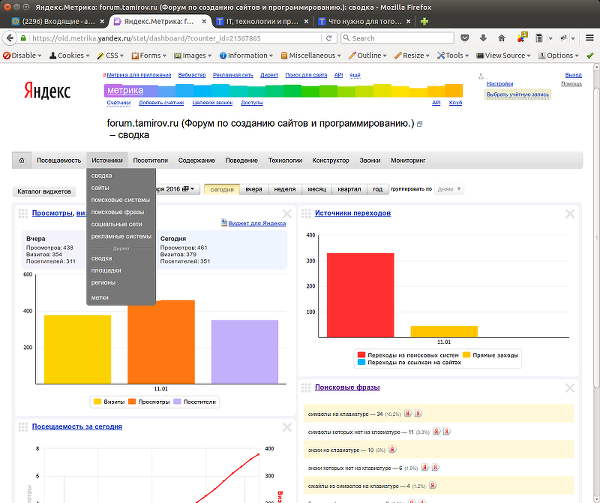

Вообще, моё мнение такое, что если у вас какой-то специализированный ресурс, например, по тематике, связанной со строительством, или автомобильным ремонтом, то вам нужно садиться и самим писать материалы для сайта. А критерием качественного материала станет то, что посетители вашего сайта сами начнут на вас оставлять ссылки с форумов, блогов и других сайтов. А это очень хорошо — поисковики вообще любят, когда на сайт ссылаются, ибо это означает, что ваш ресурс реально полезен людям. - Второй фактор в оценке качества вашего сайта — это поведение пользователей по отношению к вашему сайту. Самый простой пример: если просматривая результаты поисковой выдачи, пользователи переходят на ваш сайт и тут же возвращаются обратно в поисковик и переходят на другие сайты, то поисковый алгоритм посчитает что ваш сайт чем-то плох, по крайней мере он не удовлетворяет поисковому запросу. Продолжить анализировать поведение пользователей поисковые машины могут и на самом вашем сайте, благо Яндекс, Google предпринимают для этого много усилий, предлагают свои браузеры, всякие плагины к ним, сотрудничают с интернет счетчиками, предлагают устанавливать на сайты свои сервисы мониторинга (Яндекс-метрика, Google analytics ...). В общем, если пользователь задерживается на вашем сайте, переходит по ссылкам на нем, то это хороший признак с точки зрения поисковой машины.

И технологии отслеживания действий пользователей постоянно проникают все глубже,

вот пара скриншотов из Яндекс-метрики для этого сайта:

Одно из следствий развития технологий мониторинга — это внедрение персонализированной поисковой выдачи*. - Ну и можно отдельно выделить третий признак, по которому поисковые алгоритмы считают ресурс хорошим — это наличие ссылок с других ресурсов этой же тематики на ваш сайт. Как я написал в первом пункте, вы можете получить обратные ссылки если ваши материалы будут настолько интересны, что люди сами начнут на них ссылаться. Но, возможно, не у всех есть такие таланты в изложении, тогда приходится просить другие ресурсы размещать на вас ссылки, платя им за это. Но здесь очень важно не переборщить, иначе это будет расценено как ссылочный спам, и опять-таки к вам применят санкции в виде пессимизации или бана. Т. е. ссылки нужно покупать тщательно их выбирая вручную. Про то стоит ли пользоваться автоматическими сервисами по закупке ссылок, я даже говорить не буду.. там качество никакое, как бы они себя ни рекламировали.

*Но опять-таки, технологии не стоят на месте. Веб-сервисы собирают все возможные данные о пользователе, работающем за конкретным компьютером/браузером/мобильным устройством и бог знает чем ещё.. Одно из применений собранной информации — это организация персонализированного поиска на основе предыдущей истории поведения конкретного пользователя. Т. е. для 2-х разных пользователей сидящих за соседними компьютерами результаты выдачи по одинаковому запросу теперь все чаще становятся разными. Так что не удивляйтесь, когда вводя в поисковик какой-то высокочастоный запрос вы видите свой сайт на первом месте

Если вас такое положение дел не устраивает, попробуйте почистить Cookies в своем браузере. Хотя помимо простых cookies есть ещё способы отслеживания через flash cookies или через закэшированный JavaScript, css, да и наверняка еще есть способы.

В общем, как человек, который занимается продвижением сайтов уже лет 6, и наблюдающий всю эту историю, могу только советовать для продвижения своего бизнеса использовать комплексный подход (буклеты, визитки, вирусный маркетинг, сарафанное радио и т. п.), и не уповать только на быстрое попадание в топ поисковых систем.

UPD.

Год после знаменитой конференции Александра Садовского (руководителя поисковых сервисов Яндекса), на которой он объявил о том, что с 2014 года Яндекс перестанет учитывать при ранжировании внешние ссылки по коммерческим запросам.